关注

谷歌 Google

1582人关注

创立于1998年,由拉里·佩奇和谢尔盖·布林共同创建。Google拥有包括智能手机,搜索引擎,移动操作系统,广告服务等产品。Google的搜索引擎是其最出名的产品,被认为是全球最大的搜索引擎。

展开

全部产品

Pixel 4系列

Pixel 4 XL系列

Pixel系列

Google 谷歌 Pixel 5a 5G手机 6GB+128GB 黑色

IP67 防尘防水,3.5mm 耳机接口

近期好价:¥5759起

Google 谷歌 pixel 6 5G手机

居中打孔全面屏设计,屏占比极高

近期好价:¥7979起

Google 谷歌 Pixel 4 4G手机

90Hz屏幕,Soli微型雷达,Google Assistant语音助手

近期好价:¥1209起

Google 谷歌 Pixel 5 4G手机

HDR支持,双像素相位检测自动对焦

近期好价:¥6049起

Google 谷歌 Pixel 4 XL 4G手机

90Hz屏幕,Soli微型雷达,Google Assistant语音助手

近期好价:¥2600.21起

查看更多

全网晒物

种草笔记

值友们都在晒

外形外观

屏幕音效

拍照效果

运行体验

重量手感

是因为颜值,颜色漂亮单手可操作?原汁原味的安卓系统,没有花里胡哨的功能?搭载的平平无奇的AI大模型?还是它的谷歌自研处理器、直屏设计、30倍潜望长焦?

白日梦想家1124

178

谷歌Pixel 9是谷歌即将推出的一款手机,渲染图显示其保留了Pixel一惯的设计语言,如前置摄像头仍位于屏幕顶部中央,而直角边框与圆润的拐角相结合,赋予Pixel 9更佳的质感。谷歌Pixel 9将采用先进的FOWLP(扇出型晶圆级封装)技术的Tensor G4芯片,这有助于减薄芯片晶圆的厚度,提高散热性能和整体效能。另外,谷歌Pixel 9将配备一块6.03英寸的OLED显示屏。在尺寸方面,Pixel 9的尺寸约为152.8×71.9×8.5mm,后置摄像头凸起后为12mm。电源键和音量键位于手机边框的右侧。

放弃治疗摆烂君

4

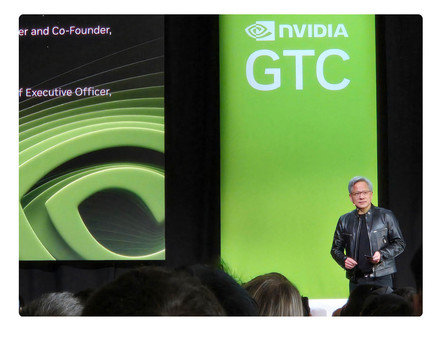

英伟达GTC大会当之无愧的重头戏,也是黄仁勋除了自己的主题演讲外唯一参与的环节,真真是万众期待的一场世纪对话,来了:今天上午,老黄亲自领衔七位Transformer发明人、开山巨作「Attention is All You Need」作者一起登台,带来「Transforming AI」主题小组讨论。全场最大的会议室门口,慕名而来的人流也是前所未见。提前1小时已经被围得水泄不通,导致会议不得不延迟开始,完全像是巨星见面会。等待进场的人人人人人。图源:Gary Singh2017年,谷歌的八名研究人员联合发表具有里程碑意义的「Attention is All You Need」论文,引入变压器模型和自注意力机制,让NLP一夜之间变了天,人工智能领域从此不同。这篇论文也是成就后续许多大模型的奠基之作,可以说没有Transformer架构,就没有今天的ChatGPT、Claude、Gemini...这八人后来已先后离开谷歌,各奔东西。这次除Niki Parmar因紧急原因未能到场外,七人都在黄仁勋的召集下合体GTC大会。是老友重聚,更是他们史上首次在公众面前同框——足见黄仁勋和英伟达现在的势不可挡的影响力,以及如日中天的行业地位。而他们之中,除一人去了OpenAI,其余七名都选择投身创业。手中又诞生了Character.ai, Cohere, Essential AI, Inceptive这些我们耳熟能详的AI独角兽和当红公司。加上黄仁勋,造就眼前这个公司总价值巨壕的阵容。八仙同台,有种传说照进现实的感觉。整场对话围绕机器学习模型和AI技术的“昨天、今天、明天”。七位「Transformer Mafia」共同追忆了那篇明星论文的诞生故事,讨论从变换器架构提出到现在的7年里模型的发展水平,也各自讲述了自己离职谷歌的原因和创业秘辛。并且对未来模型探索方向,包括推理能力、数据来源、小型模型、评估标准等各个层次的预测。黄教主第一个从粉丝簇拥中走出,上来就笑着感叹:“今天排队的人好多!这间会议室和两个休息室全挤满了,等会儿他们一进来就得是一场混乱。”他再次强调现在是「新工业革命的开始」。英伟达从计算机图形到专注加速计算,再到将GPU应用于AI,大幅降级了人类计算成本,如今迎来了不可思议的生成式人工智能。“这种从任何数据中学习的能力是极其变革性的。在这场新的工业革命中,我们将生产出前所未有的产品。就像以前的流水线工厂会用发电机把原材料转化为有价值的产品那样,在前所未有的人工智能工厂中,原材料是数据,我们所说的GPU系统就是发电机。数字进入再产出,并且应用到各行各业。这都是从未存在过的,但我们正在见证这一切发生。你绝不想错过接下来的10年,令人难以置信的新能力将会出现,而这一切都源于一些研究人员。今天,我们邀请到了一个名为Transformer的机器语言模型发明者们,我们就以会客厅式的方式和他们聊聊。”黄仁勋还打趣说,刚刚在后台大家开了一大堆深度学习笑话,也有好多争论。不如就把嘉宾请上来,一起看看话题会引向何处。在对七位Tansformer发明人依次介绍时,他又喃喃自语道,“全是CEO,这些人的公司名字里怎么都有AI这个词。其实我也早就把A和I两个字母放在NVIDIA,只是顺序没弄对。”请出在OpenAI当Member of Technical Staff的Lukasz kaiser时还说:“天哪Lukasz,上台吧,你是现在唯一还坚持做工程师的人,你是我的英雄!”一身的幽默功力引发全场爆笑。接下来,硅星人就在GTC前排带大家一起,见证这场传奇对话:1.哪些挑战催生了Transformer和「Attention is All You Need」?黄仁勋:首先,他们从未同时在同一个房间里相见过。这个 ‘work from home thing’现在已经失控了!但它没停止创新的脚步。很高兴今天能见到你们,我们会讨论transformer重要的工作意义,令人难以置信的变革能力和对行业产生的深远影响。正如我之前所说,我们今天所享有的一切,都可以追溯到那个重要时刻。事实上,我们能够以序列和空间的方式从大量数据中学习,发现关系和模式,创建出这些庞大的模型,确实是变革性的。等会儿你们可以互相打断,互相交谈,如果意见不同,可以互相抗议甚至起身离开,今天没有什么禁忌哈哈。但回到最初——你知道作为工程师,我们需要有问题来激发灵感——是什么问题让你们挣扎,促使你们产生transformer的想法?Illia Polosukhin:我想每个人面临的问题都不一样。但对我和我们团队来说,我们当时在研究问答系统。非常简单,就是在谷歌上提出一个问题,它给出答案,而且谷歌有要求延迟极低。因此如果你想让实际的模型去搜索数据、阅读成吨的文件,需要做到极快速地处理。而当时的模型和RNN网络无法做到这一点。Jakob Uszkoreit:当时我们正处在一个生成训练数据的速度远超实际训练模型速度的时期。实际上我们用的是更简单的架构,只是用前馈网络和n-gram作为输入特征,因为它们在谷歌级别的训练上速度更快。所以看起来解决这个问题是很有价值的事情。Noam Shazeer:我们在2015年就已经看到了这种规模效应。你可以看到模型越大,它就变得越聪明。这是有史以来最简单的问题,你只是在预测下一个token。它会变得非常聪明,能够做出100万种不同的事情,你只需扩大规模,让它变得更好。一个巨大的挑战是,处理RNN确实痛苦对吧?所以当我无意中听到这些家伙在谈论,嘿,让我们用卷积或者自注意力取代它吧!我想,太好了,我们就这么做!这就像蒸汽机和内燃机的区别。我们在蒸汽机上做了各种改进,但效果一直有限。而内燃机出现后,情况就大为改观。我们仍在等待核聚变,这就是下一波革命性突破。Ashish Vaswani:我想,我一直被这两个教训所提醒,尤其是在transformer时期。当我在读研时从事机器翻译时,我就意识到梯度下降训练的模型是一个比我更好的老师。所以我不再学习语言规则,而是让梯度下降替我做这件事。另一点是,可扩展的通用架构终将赢得长期胜利。今天是tokens,明天可能是我们在计算机上执行的动作,它会开始模仿我们的活动,自动化我们大量的工作。所以正如我们所讨论的,transformer的自注意力机制具有极大的通用性,能让梯度下降发挥最大效用。第二个感到高兴的是物理方面的,我们随着时间推移不断优化神经网络结构和算法,以适应加速器。所以我们把这些因素结合起来,这种模式一直在重复。每当我们有新的算法突破时,它都学得更快更好。Noam Shazeer:就是这样!整个深度学习领域都是如此,我们每次都是在构建一个适应GPU特性的AI模型,而不是反过来的。所以现在我们实际上是在为超级计算机构建人工智能模型,你们都懂的哈哈。黄仁勋:只是友情提示,我们正在做适合新模型的超级计算机。

jayyan666

0

马斯克是真男人,各种专利一个接着一个开放,先是电动汽车,然后是火箭,现在开放人工智能大模型Grok-1,任何人随便免费用。不过这个代源码文件有点大啊,接近300GB,不是专业的服务器设备,根本无法打开,所以普通人基本接触不到。马斯克之所以开源那么多专利技术,目的是为了美国在软件行业引领世界做出的其中一份努力,大家想想,当专利公布后,全世界肯定会有很多科技公司为了节约研发成本,直接套用这种代源码。这样一来,全球各大企业研发的高科技软件,都是基于美国平台,被迫跟着人家发展思路走,如此一来就永远不可能超越美国。美国软件公司迄今为止开源了成千上万种源代码和专利,普通人最了解的应该就是安卓系统,很多手机公司用着用着就无法离开了。而到了关键时刻,美国下令让谷歌断供,绝对能让用安卓系统的手机在国外市场崩溃,手机直接变成砖头。因此没必要鼓吹马斯克开源各种专利,人家的目的不是为了让全球企业共同进步,而是为了让别人的发展永远走在美国后面。

车友车行丶

1

在最近的网络搜索界,出现了一件足以引起广泛讨论的“骚操作”🔥。一些细心的网友发现,当我们在谷歌搜索特定内容时,比如“最好的助听器”,除了谷歌自家的搜索结果,竟然还会冒出一个来自必应的广告。点进去之后,眼前展开的却是必应的搜索结果界面,上面同样展示着关于“最好的助听器”的各种信息🍽。这一发现不禁让人好奇,微软为什么要在谷歌的搜索结果页投放必应的广告呢?🤔 原来,这是微软利用谷歌的流量,试图引导用户跳转到必应的一种策略。通过支付广告费用给谷歌,微软希望能够通过这种方式增加必应的用户量,进而有机会展示更多的广告,创造利润💸。然而,这种策略真的有效吗?为什么用户会从谷歌跳转到必应进行搜索呢?毕竟,用户可以直接在谷歌获取所需的信息,跳转到另一个搜索引擎似乎有些多此一举。但从另一角度看,这也许是微软在激烈的搜索引擎市场中,试图寻找新的生存和发展空间的一种尝试🚀。虽然这种策略的成效尚未可知,但它无疑为搜索引擎之间的竞争添了一抹亮色,也让我们见识到了互联网世界中各大公司的智慧与策略。让我们拭目以待,看微软的这一“骚操作”能否为其带来预期的效果吧👀。

Jeep乔格

0

Gemma模型是Google最近发布的一款开源大型语言模型,旨在帮助开发者负责任地构建AI应用。该模型提供了两种规模版本:2B(20亿参数)和7B(70亿参数),每种规模都有预训练变体和指令调整变体。Gemma模型支持所有主要的机器学习框架,包括JAX、PyTorch和TensorFlow,并提供了现成的Colab和Kaggle笔记本,以及与Hugging Face、MaxText、NVIDIA NeMo和TensorRT-LLM等流行工具的集成。预训练和指令调整的Gemma模型可以在笔记本电脑、工作站或Google Cloud上运行,并且在Vertex AI和Google Kubernetes Engine(GKE)上部署容易。使用条款允许所有组织无论大小如何都可以进行负责任的商业使用和分发。关于Gemma模型的下载,新闻来源提到Gemma是免费使用的,并且可以在Kaggle上免费使用,对于Colab笔记本也有免费层,同时新用户还可以获得Google Cloud的$300信用额度。因此,如果您想尝试使用Gemma模型,可以在Kaggle或Colab上查找相关资源,或者作为Google Cloud的新用户利用信用额度进行尝试。如果您是研究人员,还可以申请高达$500,000的Google Cloud免费信用额度。Citations:[1] https://jingyan.baidu.com/article/8ebacdf0571be308f65cd5cc.html[2] https://zhidao.baidu.com/question/1515416390017075580.html[3] https://www.tiaomaruanjian.com/news/6/show-690.html[4] https://news.tongbu.com/m/88392.html[5] https://ixigua.com/video/6889706758814728716[6] https://jingyan.baidu.com/article/48b37f8d771fd25b65648827.html[7] https://jingyan.baidu.com/article/676629975dacda15d41b8466.html[8] https://zhutix.com/software/quxiaojiandunpai/[9] https://www.mathtype.cn/jiqiao/mathtype-hbxaa.html[10] https://blog.csdn.net/weixin_48164819/article/details/125129459

太平洋的水

2

查看更多

谷歌 Google 邀请您参与品牌共建

晒好物

写文章

建百科

品牌报错